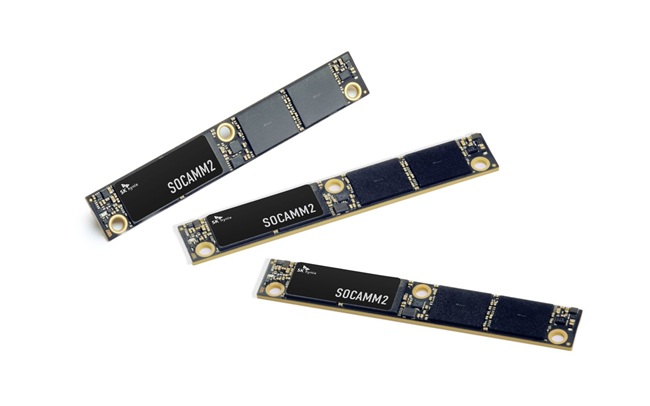

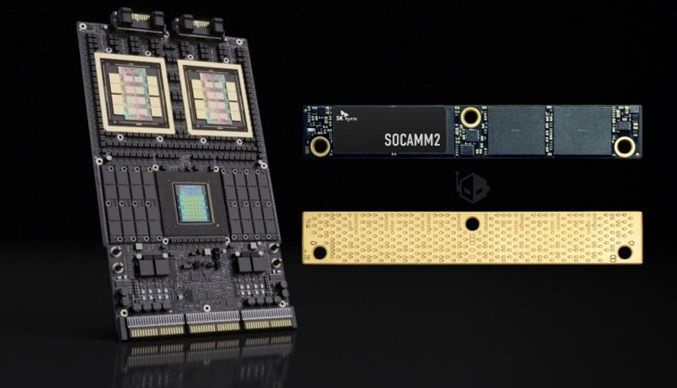

ماژولهای حافظه SOCAMM در ابتدا قرار بود جایگزین حافظههای SODIMM در لپتاپها شوند. اما برتریهای SOCAMM2 مثل پهنای باند بالاتر، تأخیر پایینتر و ظرفیت بسیار بیشتر نسبت به حافظه های RDIMM، اکنون آن را به یکی از گزینههای اصلی در سرورهای هوش مصنوعی تبدیل کرده است.

شرکت کرهای اسکی هاینیکس (SK Hynix) در یک اعلامیه رسمی تایید کرد که تولید انبوه حافظههای نسل جدید SOCAMM2 با ظرفیت خیرهکننده ۱۹۲ گیگابایت را برای دیتاسنترهای هوش مصنوعی و به طور ویژه برای شرکت انویدیا (NVIDIA) آغاز کرده است. این ماژولها، قطعهای حیاتی برای پلتفرم نسل بعدی Vera Rubin انویدیا به شمار میروند.

چهار ماه پیش و در جریان نمایشگاه CES، اسکی هاینیکس اعلام کرده بود که راهکارهای حافظه نسل جدید خود از جمله SOCAMM2 را برای تجهیز دیتاسنترهای هوش مصنوعی به انویدیا تحویل داده است. اکنون با گذشت این زمان کوتاه، این شرکت از آغاز تولید انبوه این ماژولها خبر میدهد.

پهنای باند بیشتر در کنار مصرف انرژی کمتر

به گفته SK Hynix ماژولهای ۱۹۲ گیگابایتی SOCAMM2 بر پایه فرایند کلاس ۱۰ نانومتری پیشرفته 1cnm و حافظههای کممصرف LPDDR5X ساخته شدهاند. اسکی هاینیکس اعلام کرده است که محصولات مبتنی بر 1cnm که اکنون در خط تولید انبوه قرار دارند، در مقایسه با حافظههای سنتی RDIMM، بیش از دو برابر پهنای باند بیشتری ارائه میدهند.

این افزایش سرعت با بهبود ۷۵ درصدی در بهرهوری انرژی همراه شده است که آن را به گزینهای ایدهآل برای عملیاتهای سنگین و پردازشهای سطح بالای هوش مصنوعی فراهم میکند.

استانداردی جدید در دنیای حافظههای هوش مصنوعی

جاستین کیم (Justin Kim)، رئیس و مدیر ارشد بازاریابی زیرساختهای هوش مصنوعی S.K Hynix، درباره این دستاورد مهم میگوید:

با عرضه حافظههای ۱۹۲ گیگابایتی SOCAMM2، شرکت اسکی هاینیکس استاندارد جدیدی را برای عملکرد حافظههای هوش مصنوعی پایهگذاری کرده است. ما جایگاه خود را به عنوان قابلاعتمادترین ارائهدهنده راهکارهای حافظه هوش مصنوعی، از طریق همکاری نزدیک با مشتریان جهانی هوش مصنوعی خود تثبیت خواهیم کرد.

پایان چالش گلوگاه حافظه در مدلهای زبانی بزرگ (LLM)

اسکی هاینیکس پیشبینی میکند که ماژول SOCAMM2 بتواند مشکل گلوگاه حافظه را که معمولاً در طول فرآیند آموزش و استنتاج مدلهای زبانی بزرگ با صدها میلیارد پارامتر رخ میدهد، به صورت ریشهای برطرف کند.

با تغییر تمرکز بازار هوش مصنوعی از «آموزش» (Training) به «استنتاج» (Inference) برای خدماتدهی به میلیونها کاربر مدلهای زبانی، ماژولهای SOCAMM2 به عنوان یک راهکار حافظه نسل جدید که قادر به اجرای مدلهای زبانی بزرگ با کمترین میزان مصرف انرژی هستند، توجه زیادی را به خود جلب کردهاند.

در همین رابطه بخوانید:

- استاندارد CAMM2 در حافظه های رم چیست و چه مزایایی نسبت به حافظه های RAM DIMM دارد؟

البته انویدیا برای تامین نیازهای گسترده خود به تراشههای حافظه تنها به SK Hynix متکی نخواهد بود. این غول فناوری قصد دارد برای حفظ تنوع در زنجیره تامین خود و پاسخگویی به تقاضای بازار، از ماژولهای SOCAMM2 تولید شده توسط هر سه تولیدکننده بزرگ یعنی هاینیکس، سامسونگ و مایکرون استفاده کند.

نظر خود را اضافه کنید.

برای ارسال نظر وارد شوید

ارسال نظر بدون عضویت در سایت