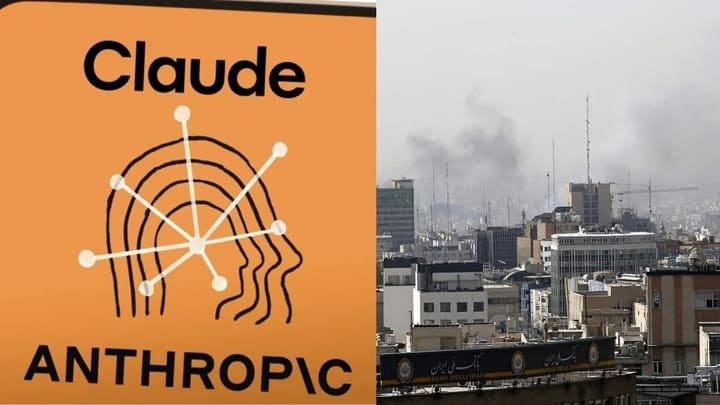

رسانه والاستریت ژورنال در گزارشی جدید فاش کرده که در جریان حملات اخیر نیروهای نظامی ایالات متحده به ایران، از سامانه هوش مصنوعی Claude شرکت Anthropic در فرآیندهای پشتیبانی عملیاتی استفاده شده است. این اقدام از آنرو جای تعجب دارد که این استفاده از هوش مصنوعی انتروپیک در جنگ، ساعاتی پس از آن اتفاق افتاده که رئیسجمهور آمریکا، فرمان ممنوعیت بهکارگیری فناوریهای این شرکت در نهادهای فدرال را صادر کرده بود.

این روزها جنگها و حتی عملیات نظامی دیگر مانند چند سال پیش نیست و ظاهراً هوش مصنوعی به صورت گسترده در همه شاخههای آنها وارد کار شده است. نمونه اخیر آن که ابتدا به آن اشاره نمیشد، در جنگ حاضر علیه ایران توسط امریکا استفاده میشود.

روزنامه WSJ چند ساعت پیش در گزارشی مفصل به بررسی این موضوع پرداخته و مدعی آن شده که ارتش امریکا در حمله اخیر به ایران در لایههای مختلف، از ابزارهای توسعه یافته توسط هوش مصنوعی شرکت انتروپک استفاده کرده است.

بر اساس این گزارش، در حالی که ترامپ دستور داده بود همه نهادهای فدرال استفاده از فناوریهای هوش مصنوعی این شرکت را متوقف کنند، بخش فرماندهی مرکزی ایالات متحده (سنتکام) در خاورمیانه در مراحل طراحی و اجرای ضربات هوایی علیه اهداف ایران از ابزار هوش مصنوعی «کلود» (Claude) استفاده کرده است.

این استفاده شامل تحلیلهای اطلاعاتی، شناسایی اهداف بالقوه و شبیهسازی سناریوهای نبرد بوده، یعنی همان وظایفی که در فاز تئوری قرار بود بهدلیل نگرانیهای امنیتی و اخلاقی از Anthropic گرفته شود و به پلتفرمهای دیگر واگذار گردد.

در گزارش والاستریت ژورنال آمده که این فرماندهی نظامی به دلیل عمق ادغام فناوری Anthropic در سیستمهای پشتیبانی تصمیمگیری و عملیات، هنوز بهطور کامل نتوانسته آن را کنار بگذارد، بنابراین علیرغم حکم ممنوعیت، سامانه کلود بهطور عملی در جریان این عملیات فعال بوده است.

عمق ترکیب فناوری هوش مصنوعی انتروپیک در عملیات ارتش آمریکا

به گفته منابع آگاه، علت اصلی تداوم استفاده این است که این سامانه پیش از این در ساختارهای اطلاعاتی و تحلیل دادههای نظامی بهشدت تعبیه شده بود و جایگزین کردن فوری آن با دیگر فناوریها امکانپذیر نبود.

این تحولات در حالی رخ میدهد که تنشها میان دولت ترامپ و شرکت Anthropic ماههاست بالا گرفته است. ایالات متحده انتروپیک را بهعنوان «خطر برای زنجیره تأمین امنیت ملی» معرفی کرده و خواستار دسترسی نامحدود به فناوری آن در کاربردهای نظامی شده بود، در حالی که Anthropic بهدلایل ملاحظات اخلاقی و ایمنی از پذیرش چنین خواستههایی سر باز زده بود.

بسیاری از تحلیلگران تاکید کردهاند که همین اختلافات منجر به این شد که فرمان اجرایی ترامپ علیه این شرکت صادر شود، اما سختبودن کنارگذاشتن فناوری عمیقاً در سیستمها ادغامشده باعث شد تا نیروهای نظامی عملاً از همان ابزار استفاده کنند.

آمریکا در عملیات دستگیری مادورو در ونزوئلا نیز از هوش مصنوعی انتروپیک استفاده کرده بود

در گزارشها همچنین اشاره شده که سامانههای هوش مصنوعی Anthropic پیش از این نیز در عملیاتهای برجستهای مثل عملیات نظامی منجر به دستگیری رئیسجمهور ونزوئلا، نیکولاس مادورو بهکار رفته بودند. این گزارشها نشان نشان میدهد این فناوری مدتها در ماموریتهای حساس نظامی مورد استفاده قرار داشته و حذف ناگهانی آن بدون جایگزینی کامل، برای فرماندهی نظامی دشوار بوده است.

نکته قابل تأمل در این زمینه آن است که رئیس جمهوری آمریکا در یکی از نقلقولهای خود درباره Anthropic گفته بود:

ما به این (فناوری) نیاز نداریم، نمیخواهیمش و دیگر با آنها همکاری نخواهیم کرد!

عبارتی که نشاندهنده واکنش شدید کاخسفید نسبت به مواضع شرکت در مورد کاربردهای فناوری هوش مصنوعی است. با این حال خلاف این ادعا در عمل اتفاق افتاده است.

این مسئله، علاوه بر ابعاد فنی و عملیاتی، بحثهای گستردهای درباره نقش هوش مصنوعی در جنگهای مدرن و چگونگی تنظیم آن در سیاستهای دولتی بهراه انداخته است؛ موضوعی که همچنان مورد توجه کارشناسان امنیت، حقوق بینالملل و فناوری قرار دارد و سوالات جدیدی در مورد تعادل میان پیشرفتهای فناورانه، امنیت ملی و چارچوبهای قانونی و اخلاقی مطرح میکند.

نظر خود را اضافه کنید.

برای ارسال نظر وارد شوید

ارسال نظر بدون عضویت در سایت