از «پدرخواندههای هوش مصنوعی» و بنیانگذار اپل گرفته تا سیاستمداران، هنرمندان و حتی اعضای خانواده سلطنتی بریتانیا؛ بیش از ۸۰۰ چهره جهانی با امضای نامهای مشترک، زنگ خطر را برای توسعه کنترلنشده هوش مصنوعی فرانسان به صدا درآوردند. این گروه خواستار ممنوعیت توسعه ابرهوش تا زمان تدوین پروتکلهای ایمنی قابل اتکا و جلب نظر مثبت افکار عمومی شدهاند.

در اقدامی کمسابقه، بیش از ۸۰۰ چهره برجسته از حوزههای مختلف از جمله فناوری، سیاست، رسانه، هنر و حتی اعضای خانوادههای سلطنتی، با امضای یک نامه سرگشاده، خواستار ممنوعیت توسعه «هوش مصنوعی فرانسانی» یا «ابرهوش» (Superintelligence) شدند. این نامه که توسط موسسه«آینده حیات» (Future of Life Institute) سازماندهی شده، بر لزوم توقف این رقابت تا زمان حصول اطمینان از ایمنی و کنترلپذیری این فناوری تأکید دارد.

چه کسانی این نامه را امضا کردهاند؟

در میان امضاکنندگان، نامهای بزرگی به چشم میخورد که اعتبار این حرکت را دوچندان کرده است. جفری هینتون و یوشوا بنجیو، که به عنوان دو تن از «پدرخواندههای هوش مصنوعی» شناخته میشوند، در صدر این فهرست قرار دارند. استیو وزنیاک، همبنیانگذار اپل، و ریچارد برانسون، بنیانگذار گروه ویرجین، نیز از دیگر چهرههای برجسته دنیای فناوری هستند که این نامه را امضا کردهاند.

دامنه امضاکنندگان فراتر از دنیای تکنولوژی است. استیو بنن (استراتژیست ارشد سابق دونالد ترامپ)، مایک مولن (رئیس سابق ستاد مشترک ارتش آمریکا)، جوزف گوردون-لویت (بازیگر)، ویل.آی.ام و گرایمز (موسیقیدان) و حتی شاهزاده هری و مگان، از اعضای خانواده سلطنتی بریتانیا، نیز با امضای این نامه نگرانی خود را از آینده کنترلنشده هوش مصنوعی ابراز کردهاند.

خواستههای اصلی نامه: ایمنی و کنترلپذیری

در این بیانیه آمده است که توسعه هوش مصنوعی فرانسان باید تا زمانی که اجماع علمی گستردهای مبنی بر ایمن و قابل کنترل بودن آن وجود داشته باشد و همچنین حمایت قوی عمومی برای آن جلب شود، ممنوع گردد.

امضاکنندگان ضمن اذعان به مزایای بالقوه هوش مصنوعی مانند پیشرفتهای بیسابقه در سلامت و رفاه، هشدار میدهند که هدف شرکتها برای ساختن ابرهوشی که بتواند در دهه آینده در تمام وظایف شناختی از انسان پیشی بگیرد، نگرانیهای جدی به همراه دارد.

خطراتی که در این نامه به آنها اشاره شده، شامل موارد آشنایی مانند از بین رفتن گسترده مشاغل و منسوخ شدن اقتصادی انسان، از دست دادن آزادی، حقوق مدنی و همچنین ریسکهای جدی برای امنیت ملی است. در نهایت، این نامه حتی به پتانسیل «انقراض کامل نسل بشر» به عنوان یکی از پیامدهای احتمالی اشاره میکند.

نگرانی عمومی در برابر سرعت سرسامآور شرکتها

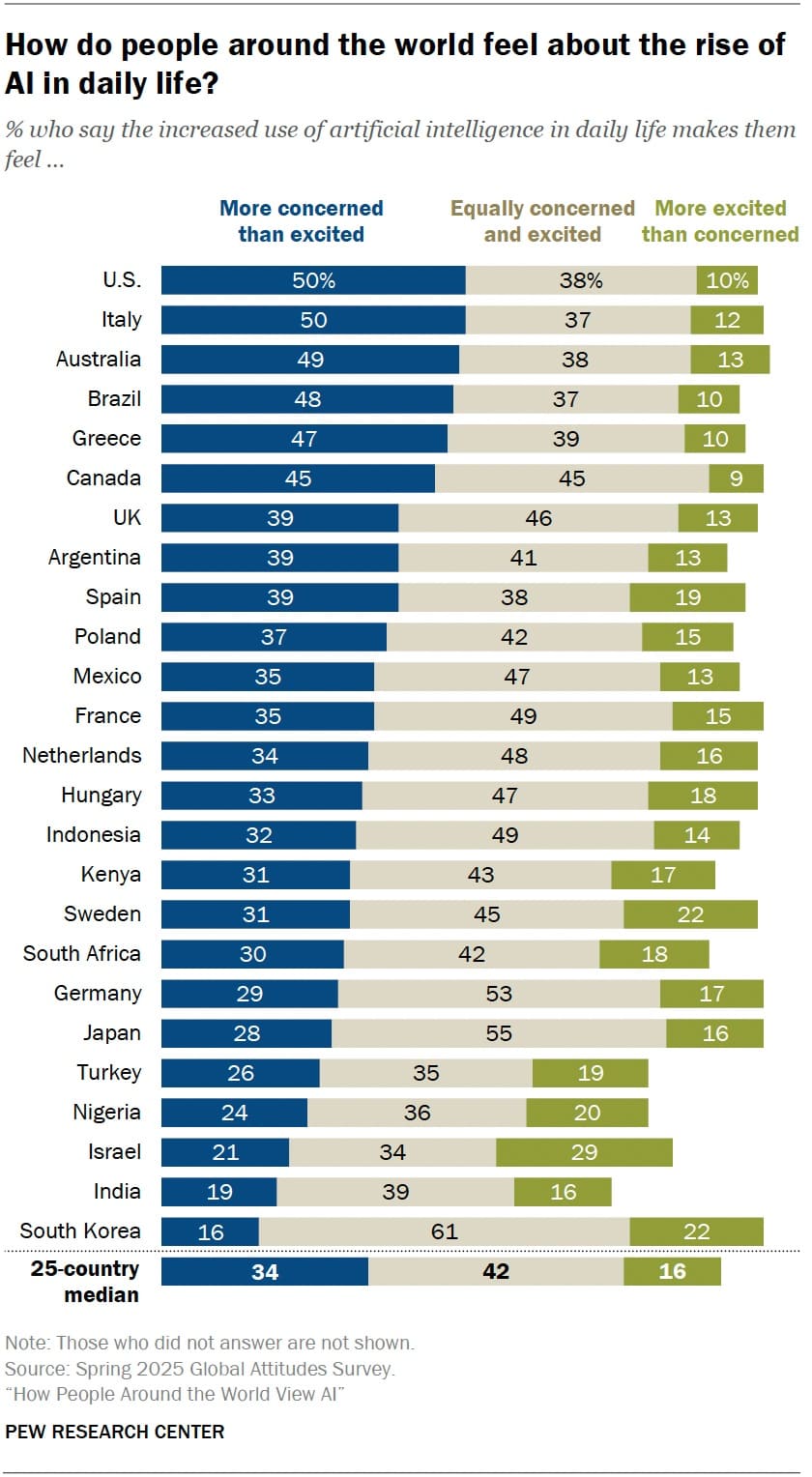

این نگرانیها تنها به نخبگان محدود نمیشود. بر اساس یک نظرسنجی در ایالات متحده که روی ۲۰۰۰ بزرگسال انجام شده، شعار بسیاری از شرکتهای هوش مصنوعی مبنی بر «سریع حرکت کن و ساختارها را بشکن» تنها مورد حمایت ۵ درصد از مردم است. نزدیک به سه چهارم آمریکاییها خواستار قانونگذاری قوی برای هوش مصنوعی پیشرفته هستند و از هر ۱۰ نفر، ۶ نفر معتقدند که توسعه آن باید تا زمان اثبات ایمنی و کنترلپذیری متوقف شود.

با این حال، به نظر نمیرسد غولهای فناوری قصد کاهش سرعت خود را داشته باشند. سم آلتمن، مدیرعامل OpenAI، اخیراً پیشبینی کرده است که ابرهوش تا سال ۲۰۳۰ فرا خواهد رسید. مارک زاکربرگ، مدیرعامل متا، نیز در حال رقابت برای دستیابی به این فناوری است و آن را ابزاری برای «توانمندسازی» افراد میداند.

با توجه به اینکه نامه مشابهی در سال ۲۰۲۳ امضا شده بود و نه تأثیر چندانی بر روند توسعه شرکتها نداشت، بعید به نظر میرسد این حرکت نیز بتواند به تنهایی سرعت این رقابت پرشتاب را کاهش دهد. به خصوص آنکه یکی از امضا کنندگان آن یعنی ایلان ماسک، خودش به یکی از نمادهای توسعه بدون مانع AI تبدیل شده است.

نظر خود را اضافه کنید.

برای ارسال نظر وارد شوید

ارسال نظر بدون عضویت در سایت