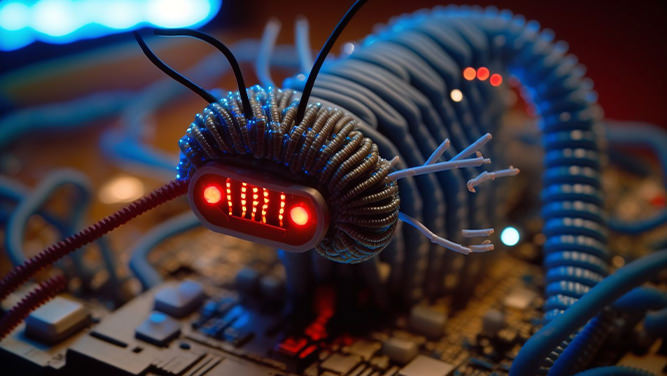

پژوهشگران توانستهاند با کمک هوش مصنوعی مولد یک کرم اینترنتی ایجاد کنند که سیستمهای مختلف را آلوده کرده و به روشهای مختلف اطلاعات کاربران را به سرقت میبرد. نتایج این پژوهش نشان داد که ما نیازمند یک چهارچوب نظارتی مستحکم بر روی هوش مصنوعی مولد و محصولات تولید شده به کمک آن هستیم.

هوش مصنوعی به شکل روز افزونی در حال پیشرفت بوده و به گفته برخی افراد بزرگ صنعت فناوری از جمله مدیرعامل انویدیا، تا پنج سال دیگر به بلوغ رسیده و میتواند مانند یک انسان رفتار کند.

برخی نگران استفاده منفی از این ابزار نوظهور برای خرابکاری هستند. به عنوان مثال، میتوان به ابزارهای مبتنی بر هوش مصنوعی پیشرفتهای اشاره کرد که در زمینه کدنویسی تبحر داشته و میتوانند به هکرها در ساخت بدافزارهای خطرناک نسل جدید کمک کنند.

ساخت کرم اینترنتی با هوش مصنوعی مولد!

در این راستا، گروهی از محققان یک کرم هوش مصنوعی نسل اول ایجاد کردهاند که میتواند دادهها را دزدیده، بدافزار منتشر کرده و از طریق یک کلاینت ایمیل به سیستمهای دیگر قربانیان راه یابد.

به گفته پژوهشگران، این کرم بدافزاری مبتنی بر هوش مصنوعی با کمک مدلهای زبانی بزرگ (LLMها) محبوب طراحی شده و در محیط آزمایشگاهی با موفقیت کار میکند.

بر اساس یافتههای به دست آمده از این بررسی، پژوهشگران به توسعهدهندگان ابزارهای هوش مصنوعی مولد هشدار داده و نگرانی خودشان در رابطه با خطرات بالقوهای که چنین برنامهنویسی مخربی را به اشتراک گذاشتهاند. علاوه بر این، آنها یک ویدئوی را به اشتراک گذاشته و نشان دادهاند که چطور این کرم میتواند از دو روش برای سرقت دادهها و تأثیرگذاری بر سایر قربانیان استفاده کند.

به گزارش Tomshardware، این کرم بدافزاری که موریس ۲ (Morris II) نامگذاری شده، با هدف قرار دادن اپلیکیشنهای مبتنی بر هوش مصنوعی مولد مانند Gemini Pro، ChatGPT 4.0، LLaVA و حتی دستیارهای ایمیل مبتنی Gen AI که متن و تصویر تولید میکنند، فعال میشود.

موریس ۱ اولین کرم کامپیوتری در جهان بود که در سال 1988 انتشار یافت و توانست برای کاربران اینترنت سراسر جهان را مزاحمت ایجاد کند.

همانطور که انتظار میرفت، پژوهشگران نتایج یافتههای خود را با گوگل و OpenAI به اشتراک گذاشتهاند. در حال حاضر گوگل در رابطه با این تحقیقات هیچ اظهار نظری نکرده است، اما سخنگوی OpenAI اظهار داشته است:

به نظر میرسد که پژوهشگران راهی برای سوءاستفاده از آسیبپذیریهای نوع تزریق سریع با تکیه بر ورودی کاربر (که بررسی یا فیلتر نشده است)، پیدا کردهاند.

در همین رابطه بخوانید:

- FBI هشدار داد: هکرها با هوش مصنوعی بدافزار تولید میکنند

چنین مواردی باعث شده تا ضرورت ایجاد یک چهارچوب مستحکم برای استفاده از هوش مصنوعی مولد برای عموم بیش از پیش برجسته شود.

نظر خود را اضافه کنید.

برای ارسال نظر وارد شوید

ارسال نظر بدون عضویت در سایت